Physical AI: Was droht, wenn KI einen Körper bekommt

Der Beitrag Physical AI: Was droht, wenn KI einen Körper bekommt erschien zuerst beim Online-Magazin BASIC thinking. Über unseren Newsletter UPDATE startest du jeden Morgen bestens informiert in den Tag.

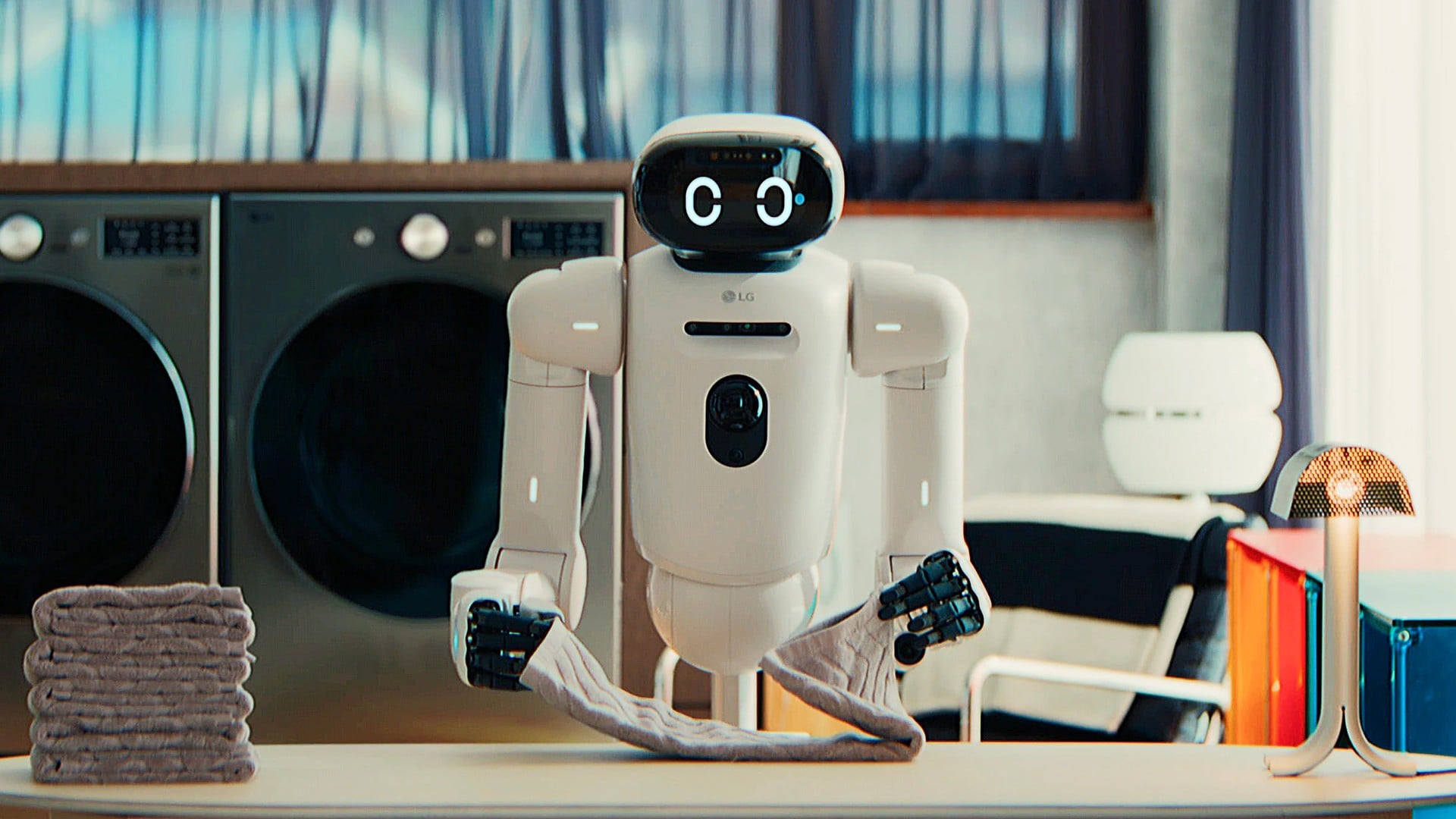

Künstliche Intelligenz erobert unseren Alltag in Form von Software-Lösungen. Doch digitale Assistenten sind erst der Anfang der KI-Revolution. Im nächsten Schritt soll Künstliche Intelligenz dabei helfen, unsere physische Welt erobern und einen Körper bekommen. Eine kommentierende Analyse.

Was ist Physical AI?

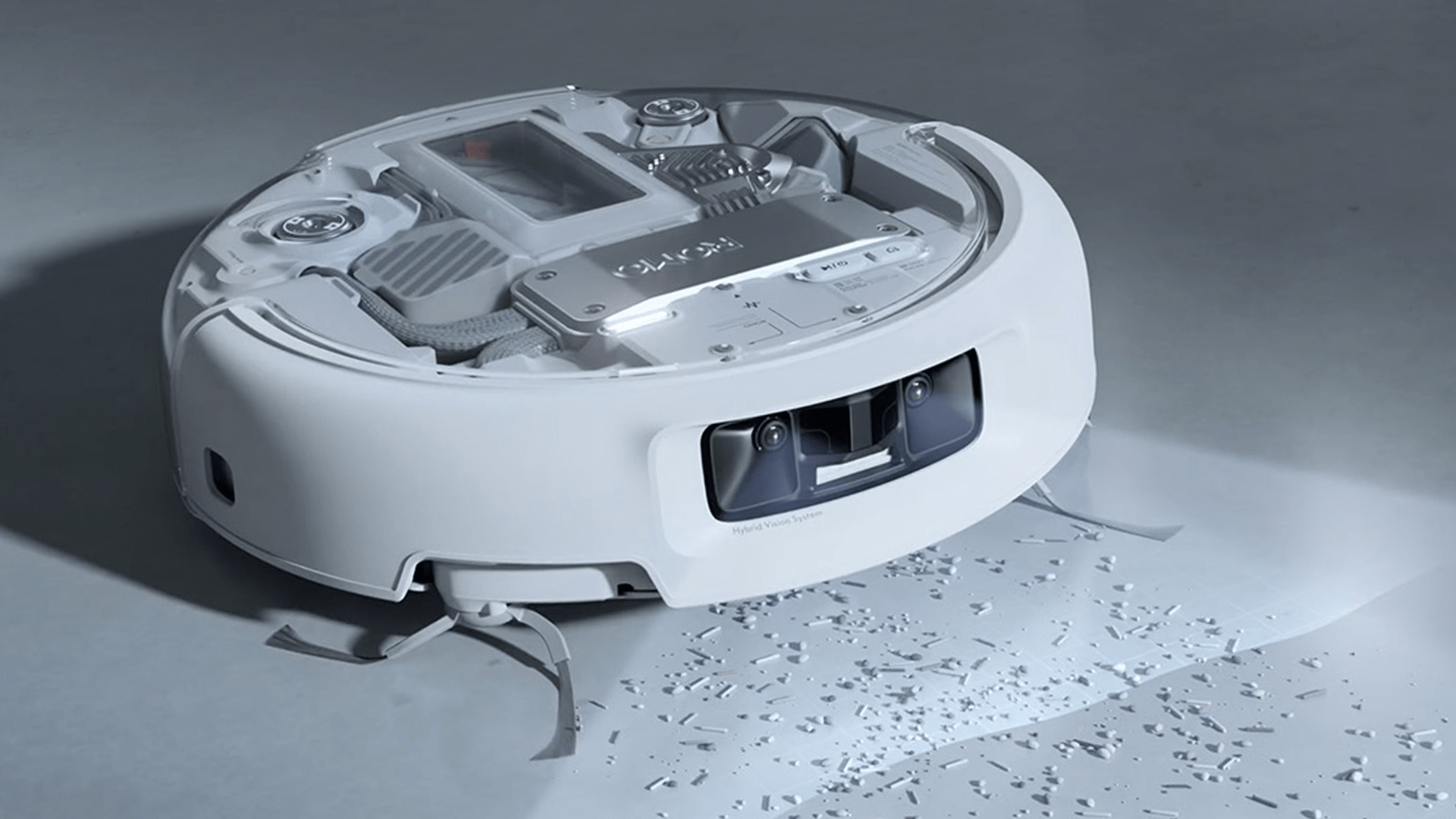

- Das Gabler Wirtschaftslexikon definiert Physical AI als „die Verbindung von künstlicher Intelligenz mit physischen Systemen wie Kameras, Geräten, Anlagen, Drohnen, Robotern und selbstfahrenden Autos und Bussen. Sie ermöglicht diesen, komplexe Vorgänge in der physischen Welt wahrzunehmen, zu analysieren, zu evaluieren und auszuführen.“

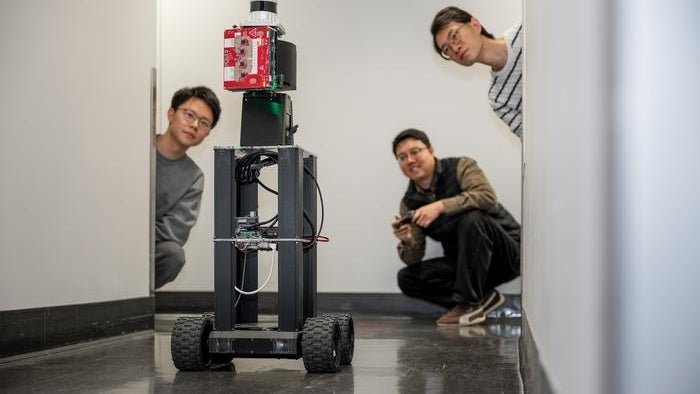

- Bislang hat sich das Training von neuen Technologien wie humanoiden Robotern oder Greifarmen in der Produktion als sehr schwierig und kostenintensiv gestaltet, da es wenige Daten gibt und ein hoher Aufwand notwendig war. An dieser Stelle setzen Multimodal Large Language Models (MLLMs) an.

- Sie trainieren humanoide Roboter mit Milliarden realen Datensätzen, ohne dass die teure Technologie gefährdet ist. Ein anschauliches Beispiel ist Nvidia Cosmos. Das autonome Auto bekommt durch Physical AI die Gefahren des Verkehrsalltags durch unzählige Videoaufzeichnungen beigebracht – ohne eine reale Fahrt auf der Straße, bei der ein Unfall einen Prototypen-Schaden in Millionenhöhe verursachen könnte.

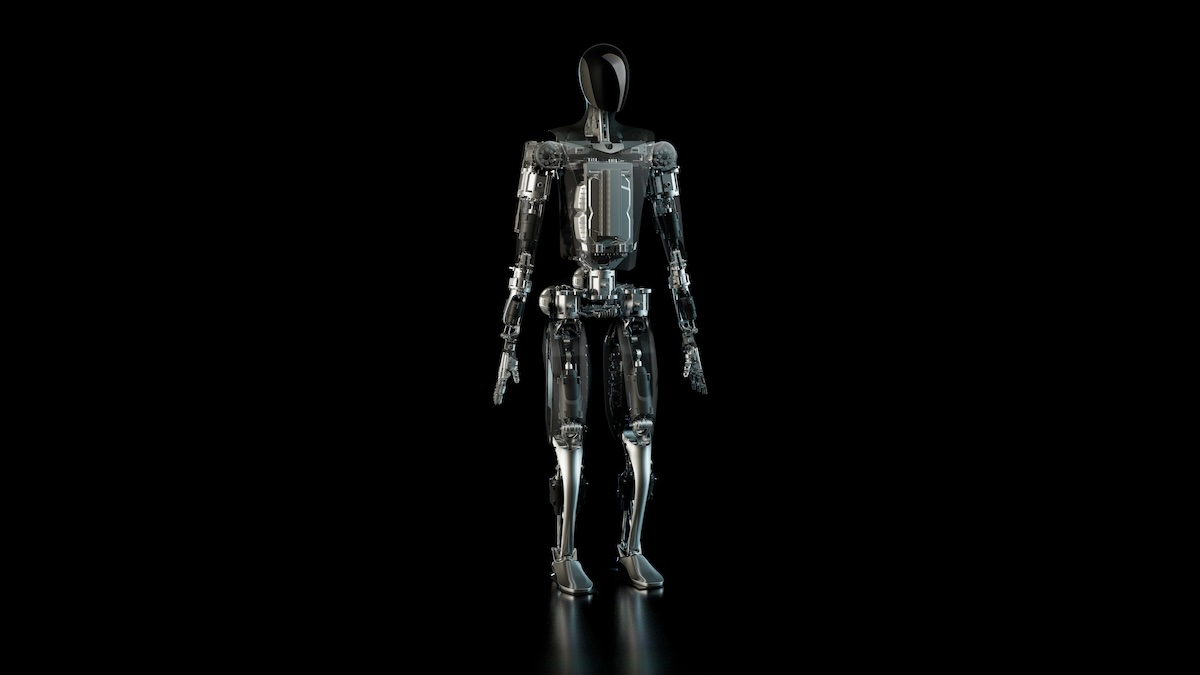

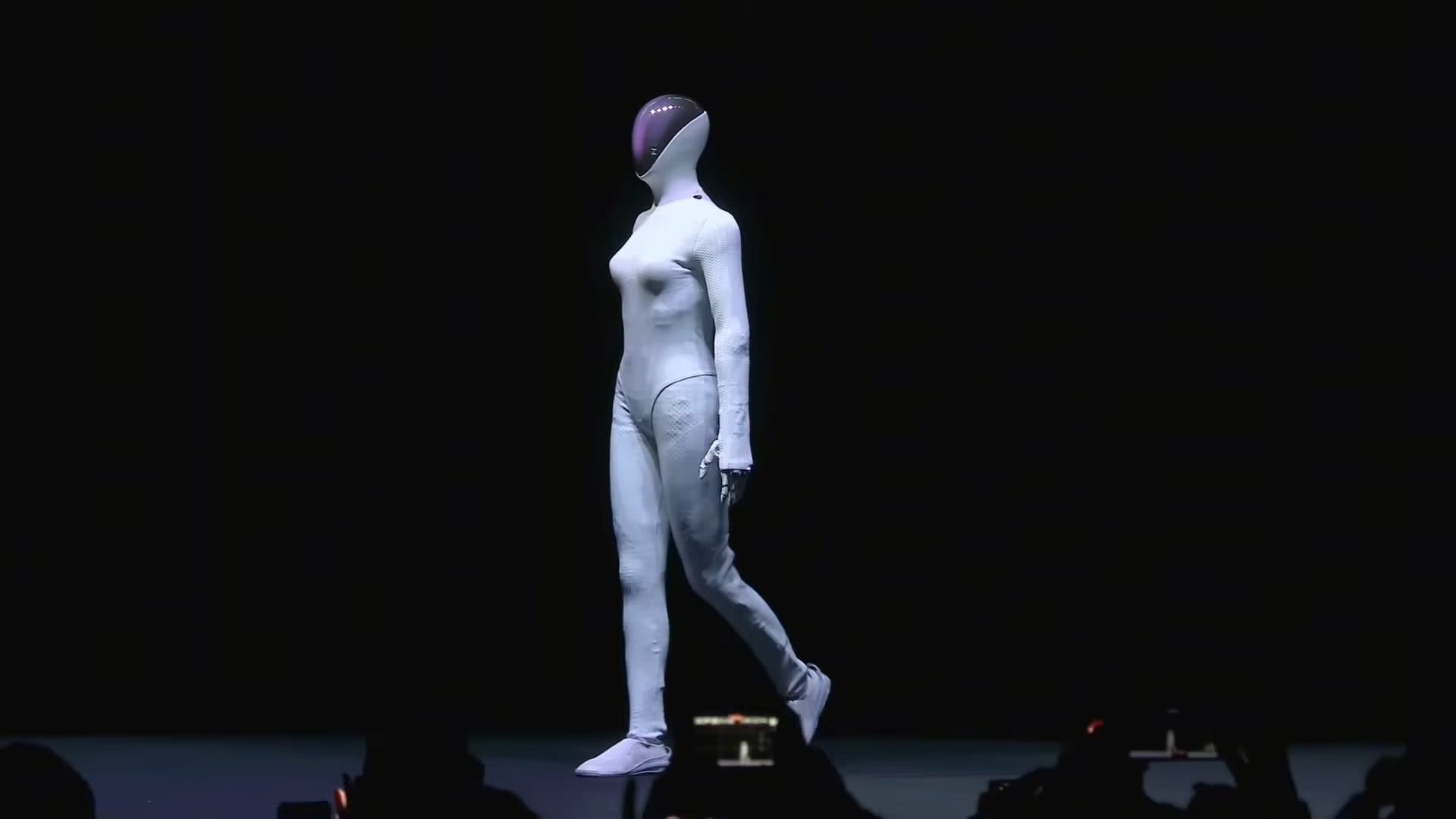

Humanoide Roboter noch viel zu teuer

Der Figure 03, Teslas Optimus und die Roboter von Boston Dynamics haben eines gemeinsam: Sie liefern teilweise beeindruckende Vorführungen, sind allerdings für den Einsatz in den eigenen vier Wänden zu teuer. Ein gutes Beispiel dafür ist auch der Pflegeroboter Moya, der knapp 180.000 US-Dollar kosten soll.

Physical AI könnte zum Gamechanger für humanoide Roboter werden. Durch das unkomplizierte Training und die Vermenschlichung der Maschinen durch den Umgang mit physikalischen Gesetzen und unberechenbaren menschlichen Umgebungen werden unsere Roboter-Assistenten immer besser. Das wiederum ermöglicht die Skalierung in der Industrie. Dort können die Roboter in einem geschützten Umfeld lernen und noch besser werden.

Sobald humanoide Roboter dann in Fabriken funktionieren, können Roboter-Produzenten wie Elon Musks Tesla die Herstellungs- und Entwicklungskosten deutlich senken. Das wiederum ermöglicht perspektivisch den Einzug in unser Privatleben.

Stimmen

- Markus Hacker, Director Enterprise DACH bei Nvidia, skizziert in einem Gastbeitrag die Weiterentwicklung der Robotik: „Roboter werden intelligente Einheiten, die nicht nur wahrnehmen, begründen und planen, sondern auch eigenständig handeln und aus ihren Erfahrungen lernen können. Ihr Einsatzbereich wird sich von Operationssälen und Rechenzentren über Fabriken bis hin zu Verkehrsleitsystemen und ganzen Städten erstrecken. Statische, manuell gesteuerte Systeme weichen zunehmend interaktiven, intelligenten Lösungen.“

- Physical AI hat nicht nur Auswirkungen auf unser Bruttoinlandsprodukt, sondern auch auf unsere Arbeitswelt. Darauf weisen Theresa Wolf und Andrea Willige vom World Economic Forum in einem Papier hin: „Maschinenbediener zu Robotertechnikern, Logistik-Teams koordinieren künftig mobile Roboter, Instandhaltungsteams verlagern ihren Schwerpunkt auf vorausschauende Wartung (Predictive Maintenance), und Fertigungsingenieure werden sich auf das Training und die Optimierung von KI- und Robotiksystemen konzentrieren.“

- Etwaigen Untergangsszenarien für die Menschheit widerspricht Professor Wolfgang Wahlster, wissenschaftlicher Direktor am Deutschen Forschungszentrum für Künstliche Intelligenz, in einem Interview: „Maschinelles Lernen unterscheidet sich prinzipiell vom menschlichen Lernen. Es geht in der KI keinesfalls darum, menschliches Verhalten mit all seinen Stärken, aber auch den vielen Schwächen perfekt nachzubilden, sondern wir wollen dem Menschen mit KI assistieren, wo dies sinnvoll ist. Beim Lernen von Regelmäßigkeiten in sehr großen Datenmengen sind maschinelle Lernverfahren dem Menschen heute bereits überlegen.“

Physical AI: Luftschloss oder Alltagshelfer?

Physical AI ist zum jetzigen Zeitpunkt mit dem Metaverse vergleichbar. Eine Technologie, die großes Potenzial bietet, ihrer Zeit jedoch voraus ist und deshalb zum Teil auf Luftschlössern in Fantasiewelten aufbaut. Realistische Schätzungen gehen davon aus, dass die ersten humanoiden Roboter gegen Ende der 2020er Jahre in Fabriken Einzug halten werden.

In unserem Haushalt könnten sie ab Mitte der 2030er Jahre helfen. Wir sprechen also trotz der steilen Lernkurve von Physical AI von einem Zeitraum von mindestens einem Jahrzehnt – ein Zeitraum, der sich kaum verlässlich vorhersagen lässt.

Fest steht jedoch, dass der Erfolg von Physical AI dazu beitragen könnte, Menschen körperlich zu entlasten. Wenn wir weniger manuelle Tätigkeiten übernehmen, können wir uns auf wichtigere Aufgaben konzentrieren.

Dazu gehört beispielsweise die Pflege von Angehörigen oder die Zeit mit der Familie. Vielleicht sorgt der technologische Fortschritt also tatsächlich einmal für eine ökonomische Entlastung der Menschheit und eine sozial-zwischenmenschliche Revolution.

Auch interessant:

- Denkzettel für Deutschland: Energiepolitik zerschellt im Iran

- Telekom will jedes Telefon zum KI-Assistenten machen – sogar Uralt-Handys

- KI-Streit im Weißen Haus: OpenAI vertickt ChatGPT ans US-Militär

- Solar-Förderstopp: Lobby-Ministerin plant Geschenk für Ex-Arbeitgeber E.ON

Der Beitrag Physical AI: Was droht, wenn KI einen Körper bekommt erschien zuerst auf BASIC thinking. Folge uns auch auf Google News und Flipboard oder abonniere unseren Newsletter UPDATE.