Selbstreinigende Solaranlagen: Neue Beschichtung sorgt für Leistungs-Boost

Der Beitrag Selbstreinigende Solaranlagen: Neue Beschichtung sorgt für Leistungs-Boost erschien zuerst beim Online-Magazin BASIC thinking. Über unseren Newsletter UPDATE startest du jeden Morgen bestens informiert in den Tag.

Forscher haben eine Beschichtung entwickelt, mit der sich Solaranlagen selbst reinigen können. Sie soll sich auch für bestehende Module eignen und deren Leistung erhöhen.

Forscher aus Schottland, China und Indien haben eine transparente, wasserabweisende Beschichtung für Solarmodule entwickelt. Diese zweischichtige Lösung soll die Panels selbst reinigen und dadurch die Stromausbeute erhöhen, ohne den Lichteinfall zu verringern. Ein wesentlicher Vorteil gegenüber bisherigen Lösungen auf dem Markt ist der Verzicht auf sogenannte Ewigkeitschemikalien (PFAS).

Staub, Schmutz und Vogelkot bremsen Solaranlagen im Alltag schlichtweg aus. Hierzu erklärte Sudhagar Pitchaimuthu von der Heriot-Watt University, dass die manuelle Säuberung oft ein teures Logistik-Puzzle ist und die empfindlichen Zellen zerstören kann. Solche Wartungsarbeiten fressen oft den Gewinn der Anlagen wieder auf.

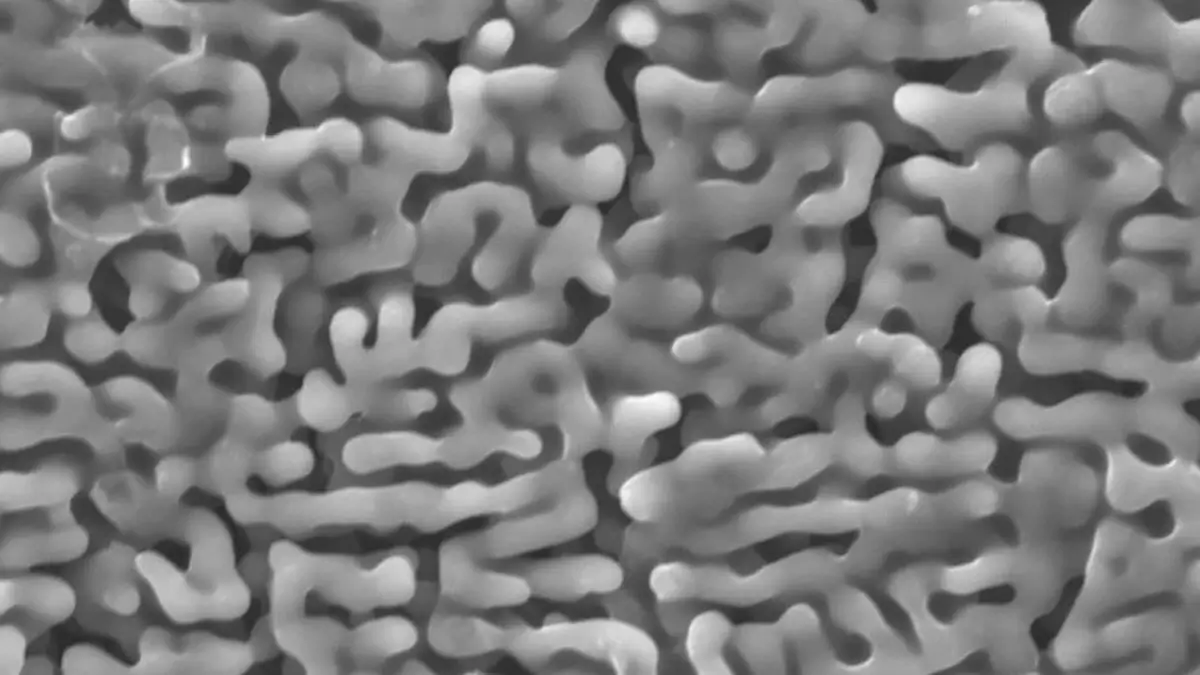

Der Nano-Trick: Wie Luft Schmutz vertreibt

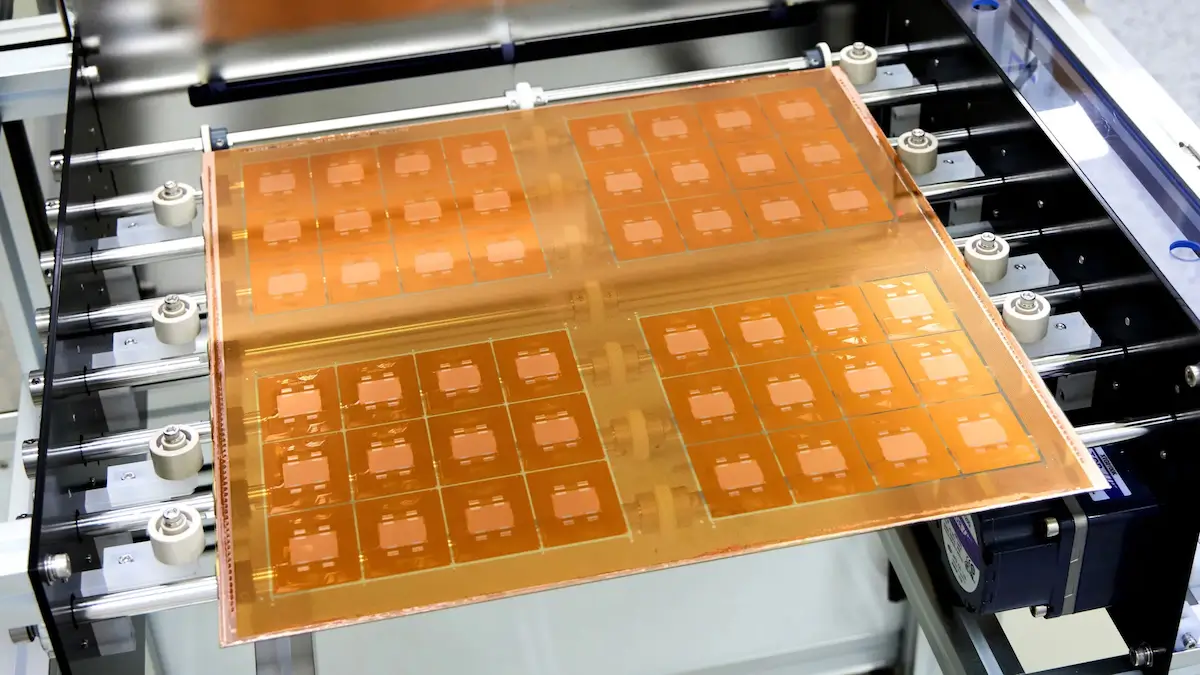

Die neue Technologie nutzt eine dünne Klebeschicht als Basis für wasserabweisende Silica-Nanopartikel. Diese Partikel sitzen zunächst in dieser Adhäsivschicht, bevor sie beim Aushärten des Materials fest einrasten. Sie erzeugen eine mikroskopische Rauheit auf der Oberfläche, die eine feine Luftschicht einschließt. Dadurch perlt Wasser in Tropfenform ab und nimmt Schmutzpartikel gleich mit.

Die Forscher veröffentlichten ihre Ergebnisse im Fachjournal „Colloids and Surfaces A: Physiochemical and Engineering Aspects“. Da die Beschichtung transparent bleibt, erreichen weiterhin genügend Lichtstrahlen die darunterliegenden Photovoltaikzellen zur Stromerzeugung. Dieser Prozess funktioniert rein physikalisch, ohne mechanische Einwirkung oder zusätzliche chemische Reinigungsmittel.

Selbstreinigende Solaranlagen: Nachhaltige Materialien und globale Förderung

Bei der Entwicklung setzten die Forscher bewusst auf Silica, da dieses Material reichlich in Ressourcen wie Sand oder Quarz vorkommt. Shanhu Liu von der Henan University betont, dass Silica im Vergleich zu fluorierten Polymeren oder seltenen Metalloxiden eine nachhaltigere Option darstellt.

Der bewusste Verzicht auf PFAS ist für die Umwelt entscheidend, da diese „Ewigkeitschemikalien“ in der Natur nicht abgebaut werden können. Sie reichern sich über Jahrzehnte in Ökosystemen an, was die Umwelt enorm belasten würde. Für die geplante Produktion ist zudem die Verwendung von grünem Ammoniak vorgesehen, das aus erneuerbarem Wasserstoff entsteht.

Die National Natural Science Foundation of China sowie die State Key Laboratory of Water Pollution Control and Green Resource Recycling Foundation finanzieren die Forschung aktiv. Zudem tragen das Petro-China Research Institute of Petroleum Exploration and Development und das Seed Money Scheme des Vivekanand College das Projekt finanziell. Als Nächstes will das Team die Panels unter extremen Bedingungen wie schottischen Wintern oder in der Wüste von Dubai testen.

Markteinführung und industrielle Bedeutung

Ein großer Vorteil des Systems ist die einfache Handhabung bei der Nachrüstung bestehender Anlagen. Man kann die Schicht einfach auf alte Module aufsprühen, um deren Selbstreinigungskräfte nachträglich zu aktivieren. Das Forscherteam geht davon aus, dass das Produkt innerhalb der nächsten fünf Jahre marktreif sein wird.

Sanjay S. Latthe ist überzeugt, dass die Technologie die Ausbeute der weltweiten Solarparks – die aktuell fünf Prozent des Stroms liefern – nachhaltig verbessern kann. Eine höhere Energieausbeute bestehender Anlagen sorgt für eine effizientere Nutzung sauberer Energie ohne zusätzliche Neuinstallationen. Die Reduzierung der Wartungskosten ist ein entscheidender Hebel, um dieses Ziel weltweit schneller zu erreichen.

Auch interessant:

- Einfach erklärt: Wie funktioniert eigentlich ein Windrad?

- E20: Was du über den neuen Bio-Sprit wissen musst

- Pseudo-Lärm und Infraschall: Keine Belege für Windrad-Mythen

- Elektroauto gebraucht kaufen: Darauf solltest du achten

Der Beitrag Selbstreinigende Solaranlagen: Neue Beschichtung sorgt für Leistungs-Boost erschien zuerst auf BASIC thinking. Folge uns auch auf Google News und Flipboard oder abonniere unseren Newsletter UPDATE.